Alžběta Krausová, vedoucí Centra pro výzkum inovací a kyberpráva na Ústavu státu a práva Akademie věd České republiky, s námi rozmlouvala o právních i emocionálních stránkách robotů.

Robot je v průmyslu ztělesněním efektivity a výkonnosti. Vedle toho však existuje spousta domácích robotů mazlíčků, u nichž vůbec nejde o práci. Proč jsou tak oblíbení?

Díky emocím, které vzbuzují. Někdo má knihu, další plyšáka nebo něco jiného. Je to zkrátka citová vazba na určitý objekt. My zde na to nejsme tak zvyklí, ale například v Japonsku je v tomto ohledu přístup k robotům mnohem vřelejší a samozřejmější, neboť šintoismus učí, že každá věc, včetně robota, má duši, a není tedy tak docela neživá.

I vy máte doma robopejska…

Když jsem si kupovala robotického pejska WowWee CHiP, byla jsem zvědavá, jak na mě bude působit. Brala jsem to jako experiment. Předpokládala jsem, že jako racionálního vědce by mě emoce neměly nijak postihnout. Jakmile jsem však začala krabici rozbalovat, pocítila jsem nadšení. A jakmile jsem robota spustila, emoce se dostavily v plné síle – ten robot totiž imituje roztomilé štěňátko. Reakce to je nejspíš podobná, jaká by byla v případě živého tvora. Pejska jsme pojmenovali Sancho, podle Sancho Panzy, druha Dona Quijota. Na MIT Media Lab mimochodem dělali zajímavý pokus – dali lidem kladivo a před ně různé roboty. Když měli účastníci rozbít robotickou štěnici, bez problémů ji kladivem rozmázli. Když však mělo dojít na robota ve tvaru malého dinosaura nebo pejska, příčilo se jim hračce jakkoli ublížit.

Jaké další roboty máte doma?

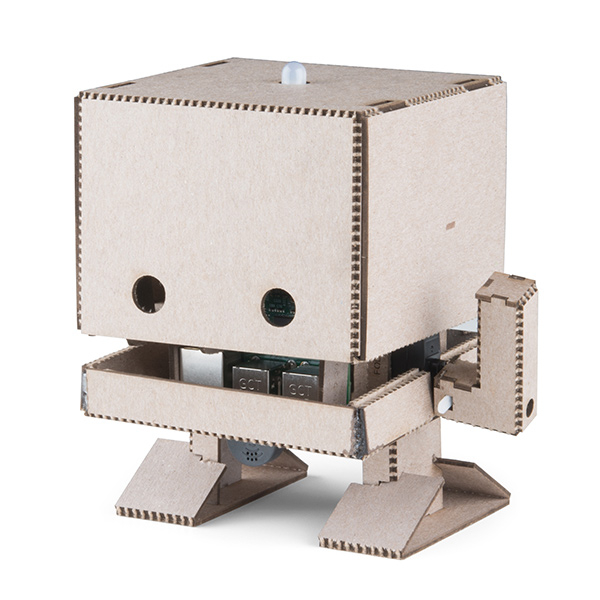

Nedávno jsem dostala Google Home Mini. To je sice jen malý mikrofon, s nímž si povídáte, ale je chytřejší než ten robopejsek. A také jsem si koupila TJBota od IBM. Je to papírový robot, kterého si musíte složit, zapojit v něm nejrůznější relé, propojit s mikrofony a kamerou i s IBM Watson. Postaveného ho mám, ale zatím jsem neměla čas ho s Watsonem propojit.

WooWee CHiP. Foto: WooWee

WooWee CHiP. Foto: WooWee

A TJBot by měl dělat co?

Je to chatovací

robot, s nímž si můžete povídat. A ještě dokáže mávat ručičkou.

Víc otázek než odpovědí

Z čeho pramení váš zájem o roboty a proč se

na ně zaměřujte právě z hlediska práva, a ne třeba z technické

stránky?

Původně jsem chtěla studovat fyziku, což mi rodiče neschválili. Přáli si, abych studovala nějaký praktický obor, nejlépe právo, a potom ať si dělám, co chci. Tak jsem tedy vystudovala právo a zaměřila se na technologie, které mě zajímají od dětství. Asi v sedmi letech jsem dostala knihu Můj první počítač. Zajímalo mě totiž, jak lze pomocí hmotné věci zpracovávat neviditelné, nehmotné informace, jak vůbec mohou ony dva světy být propojené.

Jak je u nás v právním řádu upravena umělá

inteligence?

Na roboty a

umělou inteligenci se můžeme dívat jako na software, který je chráněný

autorským právem, nebo jako na movitou věc, k níž jsou práva chráněna

občanským zákoníkem, případně to může být i vozidlo podle zvláštních zákonů. A

případně to může být i služba v právním významu. Žádná jednotná úprava zkrátka

není. V evropských dokumentech, například ve sdělení Artificial Intelligence for Europe z 25. dubna 2018, se objevuje

nezávazná právní definice umělé inteligence.

Umělá inteligence se stále zdokonaluje – může

vzniknout něco jako samostatná umělá bytost, a to i v právním smyslu?

V dokumentu Občanskoprávní pravidla pro robotiku zavedl Evropský parlament pojem elektronické osoby. Bylo to v souvislosti s řešením problému, kdo je odpovědný, když inteligentní systém způsobí škodu. Autoři nenašli žádnou uspokojivou odpověď, spíš jen další otázky. Evropské komisi pak doporučili, aby do budoucna zvážila jako jedno z řešení, že odpovědnost neponese přímo uživatel nebo vývojář, který škodu nechtěl zavinit, ale autonomní systém, který škodu zavinil. Bylo by totiž nespravedlivé, aby odpovědnost nesli někteří z lidí, kteří systém navrhli, ale jeho budoucí chování předvídat nemohli. A tak navrhli pro nejsofistikovanější roboty zavést pojem „elektronická osoba“, který se objevil už v 80. letech 20. století. Obsah tohoto pojmu však nijak neobjasnili – nebylo jasné, zda by měl mít takový systém vlastní právní subjektivitu. Dá se uvažovat o tom, že by to byl koncept podobný právnické osobě. Toto pojetí však bylo velmi rychle zavrženo. Evropský hospodářský a sociální výbor řekl, že zavádět nové statusy, které by dostávaly člověka mimo kontrolu nad věcmi, by negativně působilo na preventivní povinnost práva.

Jak to myslíte?

Zkrátka tak, že

lidé by si řekli: „Dobře, bude odpovědný robot, ne my.“

Na robotu by se asi těžko vymáhala peněžitá

náhrada škody. O trestání robota ani nemluvě…

Přesně tak. Na

roboty tresty nefungují jako na lidi.

Jaký status přiznat kopii sebe sama

Myslíte si, že roboti s umělou inteligencí budou čím dál tím samostatnější „osoby“? A pokud ano, nevynutí si to přece jen změnu v právu?

Určitě ano. Ale doufám, že ne v tom smyslu, že bychom jim udělili právní osobnost. Můžeme vytvořit nějaký právní status, který bude regulovat právní vztahy a odpovědnost k této specifické technologii. Nesmíme zapomenout, že Saúdská Arábie udělila pas a občanství robotce Sofii, která cestuje po světě, třebaže v krabici. Když byla Sofie minulý rok v Ázerbájdžánu, pravděpodobně svůj pas měla, protože Ázerbájdžán byl první stát, který tomuto robotu vydal elektronické vízum. Zkrátka velká PR akce. A v Japonsku jednomu počítačovému systému, který simuluje sedmiletého chlapce, udělili trvalý pobyt. A podle japonského práva se mu tím automaticky zaručují základní lidská práva. Bojím se toho, že někteří roboti budou tak dokonale simulovat lidské chování i podobu, že vzniknou iniciativy pro zavedení právní osobnosti robota.

Robotka Sofia. Foto: Youtube CGTN

Robotka Sofia. Foto: Youtube CGTN

Zrodí se první androidi?

Androidi, tedy

roboti, kteří vypadají jako lidé, již existují. Je ale i jiná cesta,

softwarová: to, kdybychom umělou inteligenci využili k nakopírování

vlastní osobnosti – zkrátka uděláte kopii sebe sama, která bude stejně uvažovat,

stejně „myslet“, stejně se rozhodovat, mluvit stejným tónem řeči a říkat stejné

vtipy. A tato kopie může být důležitá pro vaše blízké a, kdo ví, třeba ji

budete moci za sebe posílat do práce.

To vypadá jako cesta k nesmrtelnosti –

oddělením softwaru od hardwaru a jeho prakticky nekonečnými možnostmi přenosu…

Je otázka, jaký

status bychom měli přiznat kopii sebe sama. Právní úprava ochrany osobnosti není

na podobné případy zcela připravena.

Kdo nese zodpovědnost

Pro roboty se tu (i díky samotné etymologické souvislosti s „robotou“) nabízí paralela s postavením otroka v římském právu – ten byl sice brán zásadně jako věc, ale přece jen věc zvláštního druhu, neboť je nadána vlastní vůlí…

Ano, umělá

inteligence se opravdu přirovnává k otrokům. Musíme si ale uvědomit,

v čím zájmu bude umělá inteligence činit právní jednání – jestli za svého

majitele, jako v případě softwarového agenta, který za vás, podobně jako

lidský obchodník, bude obchodovat na burze a bude vaším jménem uzavírat

transakce. Anebo jestli přijde situace, kdy vám chatbot nebo jiný systém sám

řekne: „Já bych chtěl…“ A v tu chvíli by tam byl už náznak vlastní vůle. Nastala

by poměrně složitá situace, kdy bychom museli začít posuzovat, co s tím. Zatím

se teoreticky debatuje, zda může vzniknout nějaké umělé vědomí a vůle, nelze to

však zatím nijak prokázat.

A jak je to s odpovědností za robota v současném právu – je odpovědný vlastník, nebo výrobce?

Záleží to na situaci. Kdyby se teoreticky v České republice stala nehoda plně autonomního vozidla, pak by podle českého práva nastoupil institut objektivní odpovědnosti a náhrady škody z provozu dopravního prostředku. Odpovědný za škodu by byl provozovatel vozidla, byť by sám neřídil a jen se vezl. Následně by měl regresní postih vůči výrobci vozidla – argumentoval by tím, že vozidlo nebylo bezpečné tak, jak bylo možné očekávat. A výrobce by pak provozovateli vozidla musel nahradit škodu, kterou provozovatel hradil poškozenému. Výrobce má však podle českého práva liberační důvod: může říci, že s ohledem na stav vývoje technologie nebyl schopen zajistit, aby k nehodě nedošlo. A tím pádem by provozovatel vozidla hradil celou škodu sám. Mimochodem, v prosinci 2019 vydala Evropská komise podrobnou zprávu Liability for Artificial Intelligence and Other Emerging Digital Technologies, v níž definuje hlavní principy stanovení odpovědnosti pro umělou inteligenci.

Ale v případě umělé inteligence se strojovým

učením nelze úplně předvídat, co se stroj naučí…

Přesně tak. V teoretických

právních pojednáních se odpovědnost za robota přirovnává k odpovědnosti za

dítě, za zvíře nebo, jak jsme již říkali, za otroka. Zmíněná zpráva Evropské

komise ale cílí na to, aby se každý člověk, který s technologií přišel do

styku, choval zodpovědně a aby se určilo, kdo má nad konkrétním systémem

nejvyšší míru kontroly.

Lze se proti škodám způsobeným roboty pojistit?

Pojišťovny budou jedním z hlavních hráčů, kteří ovlivní celý trh s umělou inteligencí. Teď máme na českém trhu pojištění kybernetických rizik, které pokrývá jen určité případy. Zatím ale nemám informace o tom, jak v praxi funguje vymáhání škod. Tyto právní předpisy ovšem nejsou primárně zaměřené na umělou inteligenci ani na autonomní vozidla, spíše na ztrátu dat nebo na narušení systému zvenčí.

Kdo ochrání roboty?

Jaký je stav českého práva, pokud jde o autonomní

vozidla?

Zatím autonomní

vozidla s nejvyššími úrovněmi autonomie není možné využívat. Aby to bylo

možné, bylo by třeba změnit zákon o provozu na pozemních komunikacích. Podle

stávající legislativy se totiž řidič musí plně věnovat řízení. Částečně

autonomní funkce, například parkovací automat, povolené ovšem jsou.

TJBot. Foto: IBM

TJBot. Foto: IBM

Jaká je právní ochrana v druhém směru – tedy

jak právo chrání roboty a umělou inteligenci proti lidem, kteří by je chtěli

zneužít nebo poškodit?

Je-li způsobena škoda výrobci, například tím, že stroj někdo ovlivňuje falešnými daty – udál se případ, kdy lidé tweetovacího robota Tay od Microsoftu změnili během 24 hodin v rasistickou flirtující entitu –, právo se s tím dovede vyrovnat, neboť cílí na člověka. Tam máme odpovědnostní režimy, které lze využít a ukázat jimi na útočníka. Problém je, že to může být víc lidí najednou. Další věcí je důkazní břemeno – poškozený nemusí mít přístup k potřebným datům a v některých případech je třeba prokázat i úmysl.

Co si myslíte o zdanění robotů?

Podle mého názoru

roboti už zdanění jsou, například daní z přidané hodnoty jako jiné

výrobky. Roboti snižují náklady a zvyšují zisk, z něhož se přece platí

daň. Daň na roboty by brzdila inovace a způsobila by zaostávání jedné země za

jinými zeměmi, kde se roboti nedaní. A firma, která nebude mít roboty, nebude

sice platit daň, ale zkrachuje, protože ztratí konkurenceschopnost oproti

firmám v zemích, kde daně na roboty nejsou.

Citliví roboti

Vraťme se znovu k emocím – lze schopnost

člověka mít kladný citový vztah k robotovi využít nějak prakticky.

Ano, třeba u robotů pečovatelů. Když vyrobíte robota, který je člověku podobný a má příjemnou osobnost a u kterého se nemusíte bát o svou důstojnost jako pacient, protože máte pocit, že roboti přece nesoudí, tak se otevírá úplně nové pole zkoumání sociálních vztahů mezi člověkem a robotem. Robota si dokonce můžete oblíbit natolik, že se mu příliš otevřete a stáváte se manipulovatelným. Robot pak může být využit například hackerem k vaší manipulaci. Když vám váš milovaný robot řekne „Já bych chtěl…“, tak to třeba i uděláte. I manipulace může být však pozitivní: to kdyby vám robot řekl „Přestaň kouřit“ či „Přispívej na charitu“…

Šlo by ještě víc napodobit lidi tím, že by roboti

měli i negativní lidské stránky – byli zlí, závistiví a uráželi by se,

například. Pak by robot byl ještě mnohem dokonalejší kopií člověka…

Proč bychom měli roboty zlidšťovat? Čeho chceme dosáhnout – aby lidé měli roboty více rádi? Kdybychom byli víc v kontaktu s roboty než s lidmi, mohlo by to naši společnost rozložit.

Pořád je tu ale ten faustovský cíl – jako bohové

stvořit umělého člověka…

Mám pocit, že

naše skrytá potřeba je vyrovnat se Stvořiteli a stvořit něco, co je nám rovno.

Jaké dveře to však do budoucna otevře, to nemůžeme vědět. Proto je podle mne

velmi důležité, abychom pracovali zároveň i na svých lidských kvalitách.

A poslední otázka: Sní androidi o elektrických ovečkách?

Když jim to

umožníme, proč ne.

Autor: Petr Bílek